AI 거버넌스를 이해하려면 이 구조부터 확인해야 한다

이제 구조를 아는 것이 아니라, 판단할 수 있어야 한다

AI 거버넌스는 개념이 아니라 실행이다. 그리고 실행은 결국 질문에 답할 수 있는 구조로 증명된다.

대부분의 조직은 운영을 하고 있지만 그 운영이 어떻게 통제되는지 설명하지 못한다. 이 상태에서는 어떤 인증도 통과할 수 없다.

ISO 42001은 기술을 평가하지 않는다. AI 판단이 어떻게 감지되고, 어떻게 개입되며, 어떻게 책임지는지를 본다.

AI 거버넌스는 왜 실행 단계에서 무너지는가

AI는 이미 조직 내에서 수많은 판단을 수행하고 있다.

문제는 그 판단이 어떻게 이루어지고, 어떤 기준으로 통제되는지 설명할 수 있는 조직은 거의 없다는 것이다.

대부분의 조직은 AI를 “운영”하고 있다고 말하지만,

실제 심사에서는 운영 여부가 아니라 판단이 어떻게 통제되는지를 묻는다.

이 구조를 설명하지 못하면 심사는 멈춘다.

대부분의 심사 실패는 인터뷰에서 발생한다.

심사원은 이렇게 묻는다.

“이 AI가 잘못된 판단을 했을 때, 누가 감지하고 어떻게 개입합니까?”

이 질문에 답하지 못하는 이유는 단순하다.

조직에 판단을 통제하는 구조가 없기 때문이다.

AI는 기술이 아니라 판단 구조다.

ISO 42001은 그 판단이 어떻게 실행되고, 감지되고, 통제되는지를 검증한다.

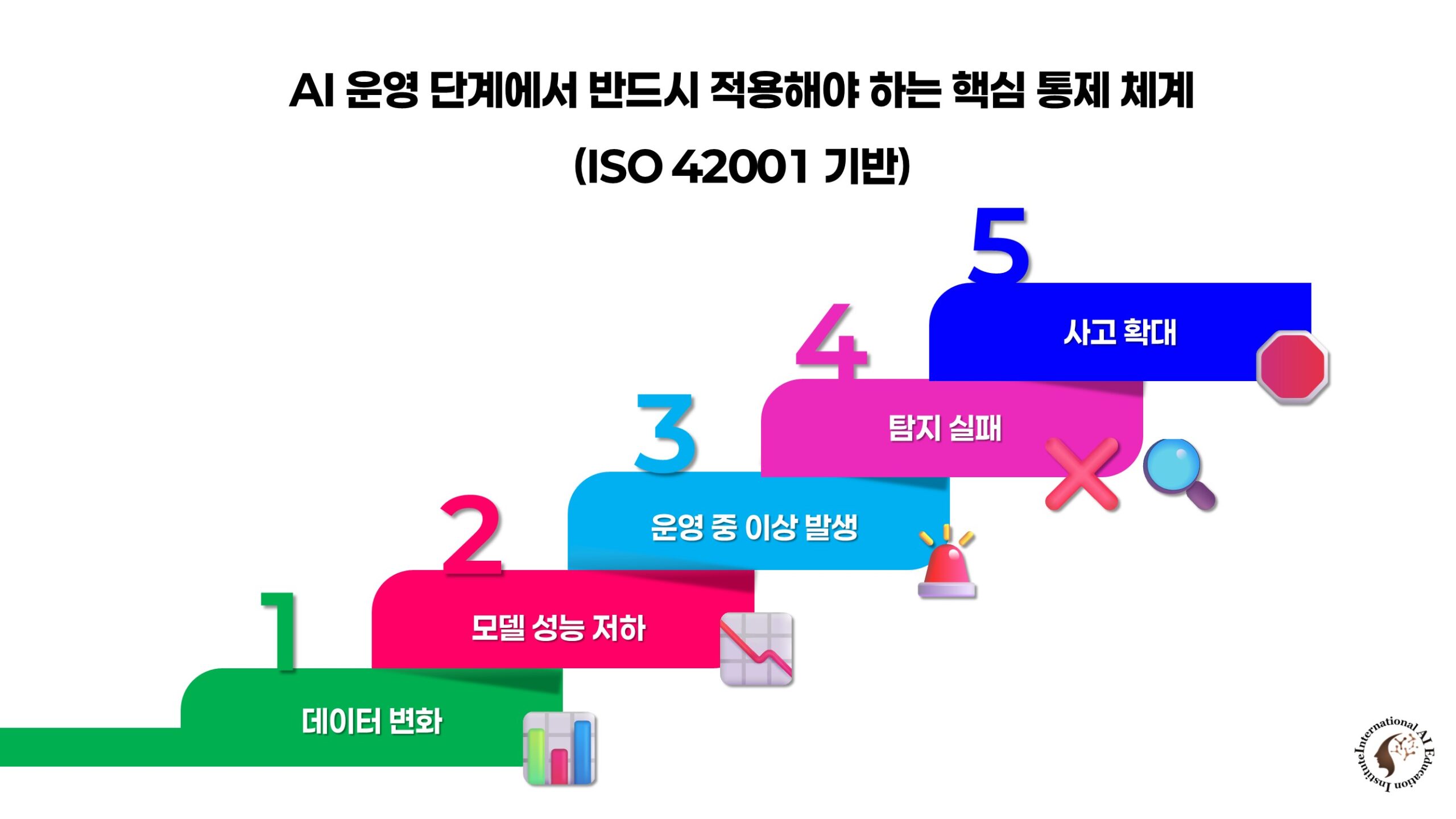

AI 운영 단계에서 반드시 적용해야 하는 핵심 통제체계 (ISO 42001 기반 5단 구조)

운영 과정에서 가장 많이 발생하는 AI 리스크는 데이터 변화, 모델 성능 저하, 운영 이상, 탐지 실패, 사고 확대로 이어지는 5단 위험 진행 구조를 보입니다. 아래 도표는 ISO 42001 운영 요구사항을 반영하여 각 단계에서 어떤 통제가 필요한지 한눈에 보여줍니다.

운영 단계별 핵심 통제 요약

- 1단계: 데이터 변화 — 데이터 품질 기준, 정기 검증(Validation) 필요

- 2단계: 모델 성능 저하 — 성능 모니터링, 리트레이닝 정책 수립

- 3단계: 운영 중 이상 발생 — 이상 탐지, 경보(Alarm) 체계, 운영 중단 기준

- 4단계: 탐지 실패 — 독립적 점검(Oversight) 및 승인 체계

- 5단계: 사고 확대 — 사고 대응 절차, 보고 체계, 재발 방지 활동

이 5단 통제체계는 ISO 42001 인증뿐 아니라, AI를 실제 운영하는 모든 조직이 반드시 갖추어야 하는 AI 운영 리스크 관리의 골격입니다.

AI 운영 통제 매트릭스: 질문·증거·판단 기준

AI 거버넌스가 실패하는 이유는 기능이 없어서가 아니라, 누가 무엇을 기준으로 판단하는지 설명하지 못하기 때문이다.

대부분의 조직은 Operation, Monitoring, Oversight를 수행하고 있지만 이 세 가지가 어떻게 연결되는지 설명하지 못한다. 이 구조가 끊기면 심사는 인터뷰 단계에서 멈춘다.

| 관리 영역 | What to ask (인터뷰 질문) | What to verify (증거) | How to decide (판단 기준) |

|---|---|---|---|

|

Operation (운영) |

모델은 어떤 기준으로 배포되는가 변경은 누가 승인하는가 운영 중단 기준은 존재하는가 |

배포 기록 변경 승인 로그 접근 권한 관리 이력 |

운영 활동이 개인 판단이 아니라 기준과 승인 절차에 따라 통제되는가 |

|

Monitoring (모니터링) |

이상은 어떤 기준으로 감지되는가 성능 저하는 언제 문제로 판단하는가 알림은 어디까지 전달되는가 |

성능 모니터링 로그 Drift 탐지 기록 알림 및 이벤트 이력 |

감지가 실제 대응으로 연결되는가 감지 실패가 반복되지 않는가 |

|

Oversight (감독) |

잘못된 판단 발생 시 누가 개입하는가 승인과 책임은 어떻게 구분되는가 최종 결정 권한은 누구에게 있는가 |

승인 기록 의사결정 로그 책임자 지정 문서 (RACI) |

판단이 개인이 아니라 구조로 이루어지는가 개입 시점이 명확하게 정의되어 있는가 |

Understanding clauses alone does not prepare you for real audits. Failure to identify risk leads to audit breakdown.

이 매트릭스의 핵심은 기능이 아니라 연결이다. Operation → Monitoring → Oversight가 하나의 판단 흐름으로 이어지지 않으면 조직은 AI를 통제하고 있다고 말할 수 없다.

이 질문에 답할 수 없다면, 이미 실패한 것이다

AI 거버넌스는 문서로 증명되지 않는다. 심사에서는 단 하나를 확인한다. “이 조직은 AI 판단을 통제할 수 있는가”

심사 질문

AI가 잘못된 판단을 했을 때 누가 개입하는가

그 판단 오류는 어떤 기준으로 감지되는가

개입 시점은 어떻게 결정되는가

대부분의 조직은 이 질문에 “설명”은 할 수 있지만 구조로 증명하지 못한다.

심사원은 답변을 이렇게 판단한다. 기준이 없으면 개인 판단, 기록이 없으면 실행되지 않은 것으로 본다.

판단 기준

감지 → 판단 → 개입 흐름이 연결되는가

책임과 권한이 분리되어 있는가

모든 판단이 기록으로 남는가

Failure to identify risk leads to audit breakdown. Most audit failures occur in interview and explanation.

이 질문에 답하지 못한다면 당신의 조직은 AI를 운영하고 있는 것이 아니라 통제되지 않은 판단을 방치하고 있는 상태다.

이제 구조를 아는 것이 아니라, 판단할 수 있어야 한다

AI 거버넌스는 개념이 아니라 실행이다. 그리고 실행은 결국 질문에 답할 수 있는 구조로 증명된다.

대부분의 조직은 운영을 하고 있지만, 그 운영이 어떻게 통제되는지 설명하지 못한다. 이 상태에서는 어떤 인증도 통과할 수 없다.

ISO 42001은 기술을 평가하지 않는다. AI 판단이 어떻게 감지되고, 어떻게 개입되며, 어떻게 책임지는지를 본다.